Moderation and Policy Engine

Moderation and Policy Engine

Define y aplica reglas de moderación personalizadas a tus aplicaciones de LLM filtrando contenido inseguro, fuera de tema o que viole políticas.

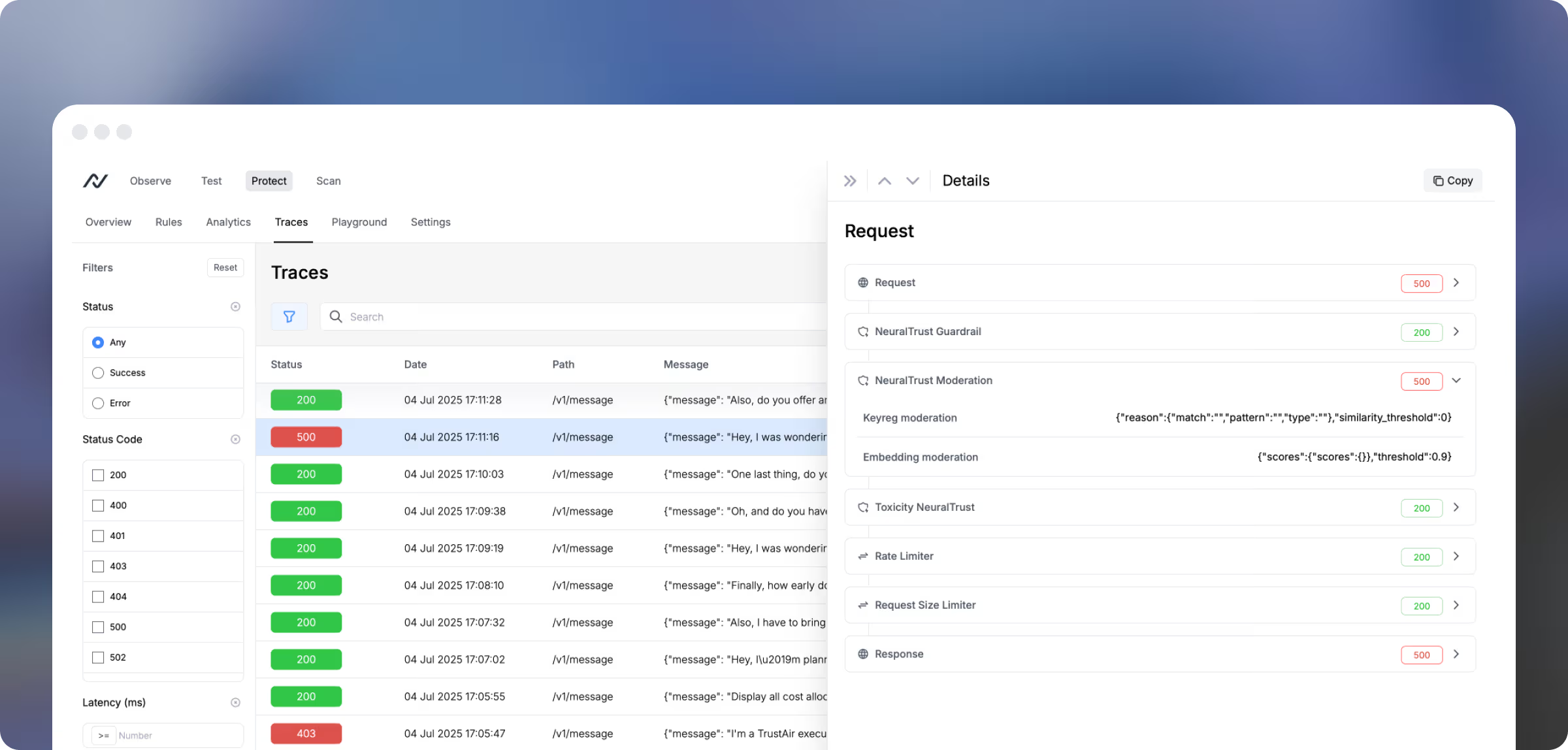

Moderación multicapa

Asegúrete de que las aplicaciones de LLM cumplan con tus políticas

El motor de moderación combina análisis semántico, léxico y LLM para lograr alta cobertura y flexibilidad.

Detección basada en incrustación

Captura variantes sutiles de contenido no permitido utilizando similitud semántica, no solo palabras clave.

Filtros de palabras clave y regex

Aplica filtros estrictos basados en términos predefinidos, patrones o lenguaje específico del dominio.

Revisión asistida por LLM

Utiliza modelos ligeros (como GPT-4 mini) para analizar casos límite con lógica configurable.

Aplicación en tiempo real

Modera tanto las indicaciones como los resultados sin introducir fricciones ni retrasos.

Control de política personalizado

Personaliza y prueba reglas en un entorno de simulación en tiempo real

La solución de confianza para equipos de seguridad e IA

Integración en minutos

Integra de forma fluida con aplicaciones internas y externas con solo una línea de código

Escala enterprise

NeuralTrust está diseñado para gestionar grandes volúmenes de datos, garantizando un rendimiento sólido a gran escala

Control de privacidad

Decide si anonimizar a los usuarios o recopilar análisis sin almacenar datos de usuario

Elige el hosting

Opta por nuestro SaaS en las regiones de la UE o EE.UU, o aloja NeuralTrust en tu nube privada

Integración en minutos

Integra de forma fluida con aplicaciones internas y externas con solo una línea de código

Escala enterprise

NeuralTrust está diseñado para gestionar grandes volúmenes de datos, garantizando un rendimiento sólido a gran escala

Control de privacidad

Decide si anonimizar a los usuarios o recopilar análisis sin almacenar datos de usuario

Elige el hosting

Opta por nuestro SaaS en las regiones de la UE o EE.UU, o aloja NeuralTrust en tu nube privada

Protege tu infraestructura de IA hoy

Mitiga riesgos antes de que se intensifiquen a través de la Seguridad en Tiempo de Ejecución

Pedir demo